极致优化:如何将 128k 上下文的显存占用从 87GB 降至 66GB?

在上一篇博文中,我们展示了双 3090/四 3090 环境下部署 Qwen3-30B 的基础性能。今天,通过引入 OLLAMA_KV_CACHE_TYPE=q8_0,我们将这项测试推向了新的巅峰:在不损失响应速度的前提下,显存占用降低了 **24%**。

1. 核心调优:什么是 KV Cache 量化?

大模型在处理长文本时,会把历史对话的 key 和 value 存在显存里(即 KV Cache)。对于 128k 这种超长上下文,这部分内存占用往往比模型本身还要大。

通过设置环境变量:

1 | export OLLAMA_KV_CACHE_TYPE=q8_0 |

我们将 KV Cache 从 16 位压缩到 8 位。结果令人震惊。

2. 优化前后数据全量对比

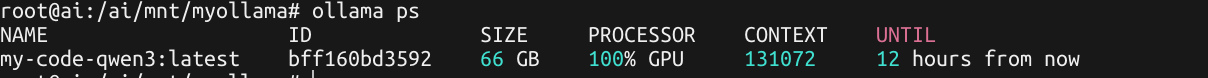

基于 4x 3090 (96GB VRAM) 环境,模型为 Qwen3-Coder-30B-A3B-Instruct-Q8:

显存占用对照表

| Context | 默认 FP16 Cache | Q8 Cache (优化后) | 节省空间 |

|---|---|---|---|

| 32k | 46 GB | 40 GB | 6 GB |

| 64k | 59 GB | 48 GB | 11 GB |

| 128k | 87 GB | 66 GB | 21 GB |

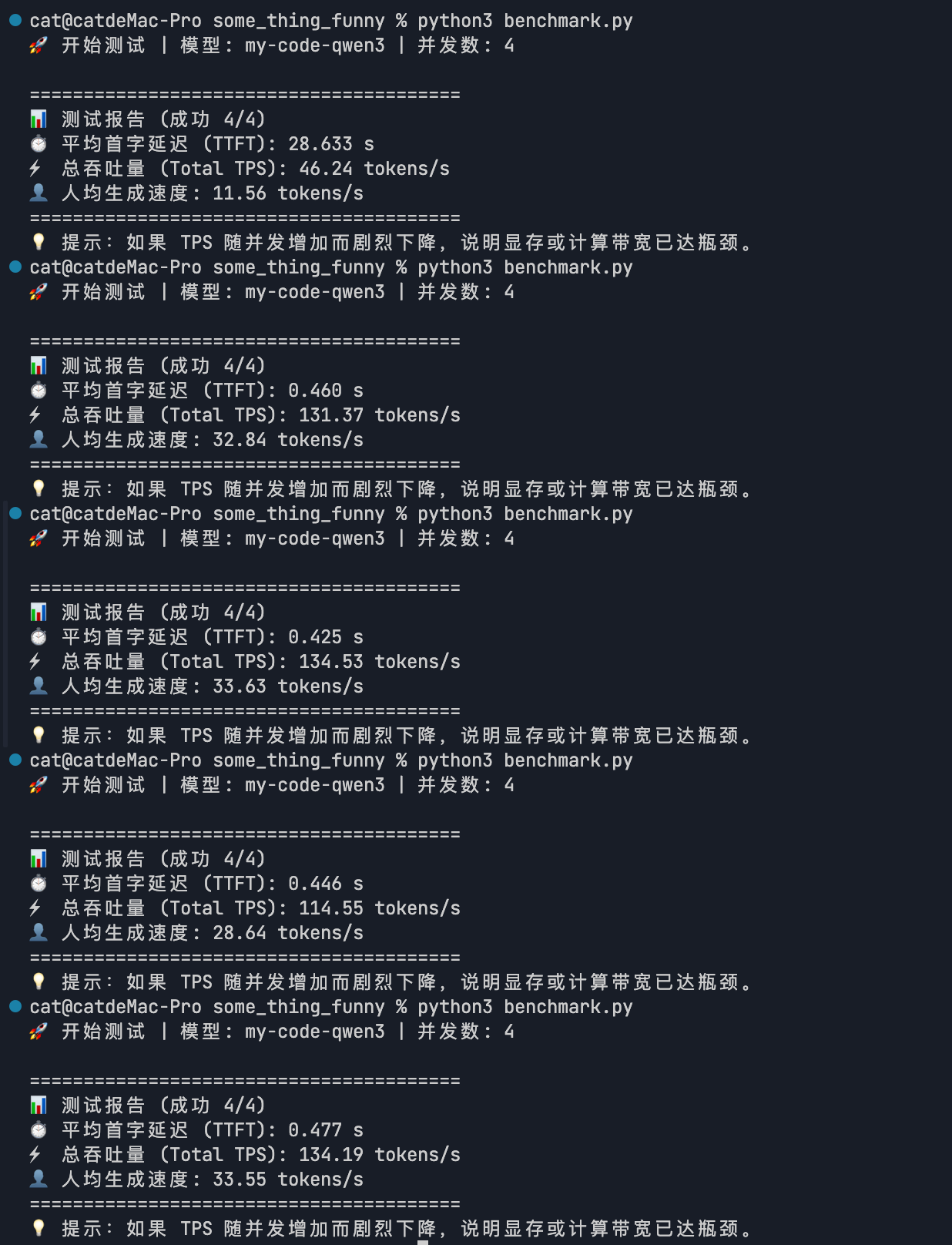

推理性能对照表 (4 并发)

| 指标 | 默认配置 | Q8 Cache (优化后) |

|---|---|---|

| 128k TPS | 112 - 132 | 131 - 134 (更稳) |

| TTFT (首字延迟) | 0.44s | 0.42s |

3. 技术分析:为什么必开 Q8 Cache?

- 带宽解耦:在 128k 场景下,计算不再是瓶颈,显存数据的搬运速度才是。Q8 减少了搬运量,让 A3B 推理引擎跑得更欢。

- 容错空间:在 128k 仅需 66GB 的情况下,你的系统不仅能稳定运行 AI 编程插件(Trae/Cursor),还能同时开启 4K 显示器渲染、多浏览器窗口,甚至后端本地调试环境,而完全不必担心显存溢出导致的系统卡死。

4. 总结:生产力环境的最佳实践

如果你拥有 48GB 以上的显存,部署 Qwen3-30B 时的黄金法则:

- 锁死 128k 上下文:给 AI 最完整的项目记忆。

- 强制开启 q8_0 Cache:用极微小的精度损失换取巨大的显存余量和更稳的 TPS。

- 并发数设为 4-8:充分利用 3090 集群的多卡并行能力。